Inteligência Artificial na Mira: Como a IA Claude Ajudou na Captura de Nicolás Maduro na Venezuela

O Pentágono dos Estados Unidos empregou o modelo de inteligência artificial **Claude**, desenvolvido pela empresa **Anthropic**, em uma operação sigilosa realizada na Venezuela em 3 de janeiro. A ação culminou na captura de Nicolás Maduro, que até então detinha o poder no país sul-americano.

Segundo informações divulgadas pelo portal americano Wall Street Journal, a utilização do Claude ocorreu por meio da empresa Palantir Technologies. Esta companhia é conhecida por sua plataforma de análise de dados, amplamente utilizada pelo Departamento de Defesa dos EUA e outras agências de segurança federais.

A Palantir atua como parceira da Anthropic, facilitando a integração da tecnologia de IA em ambientes de segurança restritos, como os utilizados pelas forças armadas americanas. A notícia, confirmada por duas fontes do governo dos EUA ao portal Axios, indica que a IA não foi usada apenas na fase de planejamento, mas também durante a execução da operação.

O Papel da IA Claude na Operação Venezolana

Embora o papel exato do modelo de IA na captura de Maduro ainda não tenha sido detalhado, as fontes citadas pelo Axios apontam que o histórico de uso militar do Claude pelos EUA inclui a **análise de imagens de satélite** e o **processamento de inteligência**. Isso sugere que a ferramenta pode ter auxiliado na identificação de localizações, rotas de fuga ou na análise de informações cruciais para o sucesso da missão.

Captura de Maduro e Acusações Federais nos EUA

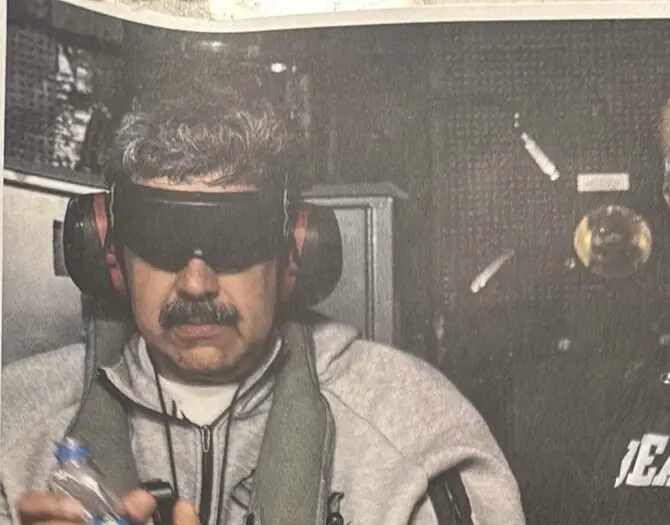

Na operação de 3 de janeiro, Nicolás Maduro e sua esposa, Cilia Flores, foram detidos e posteriormente levados aos Estados Unidos. Eles enfrentam acusações federais relacionadas a **narcoterrorismo, conspiração e tráfico de drogas**. A imprensa americana relatou que a operação transcorreu com um número mínimo de feridos, com apenas sete militares dos EUA sofrendo lesões leves.

Posição da Anthropic e Políticas de Uso da IA

Procurada pela imprensa dos EUA, a Anthropic se recusou a comentar o uso específico de sua ferramenta de IA na operação venezuelana. Em nota, a empresa declarou: “Não podemos comentar se o Claude, ou qualquer outro modelo de IA, foi usado em qualquer operação específica, classificada ou não“.

A Anthropic reforçou que qualquer uso de seus modelos deve cumprir suas Políticas de Uso, que visam regrar a aplicação da tecnologia. A empresa declarou trabalhar em estreita colaboração com seus parceiros para garantir a conformidade. Atualmente, as políticas da Anthropic proíbem o uso do Claude para apoiar atividades relacionadas à violência, desenvolvimento de armas ou vigilância.

Parceria Estratégica e Acesso Governamental

A parceria entre a Anthropic e a Palantir Technologies é fundamental para que modelos de linguagem avançados, como o Claude, possam ser integrados a sistemas governamentais e de defesa. A Palantir, com sua expertise em análise de dados e plataformas seguras, permite que agências como o Departamento de Defesa dos EUA explorem o potencial da IA em missões críticas.

A empresa de IA é, atualmente, uma das poucas desenvolvedoras de grandes modelos de linguagem com acesso a sistemas confidenciais do governo, operando através de empresas parceiras. Essa capacidade abre novas fronteiras para a aplicação da inteligência artificial em cenários de segurança nacional e operações militares.